[S01E31] Réflexions algorithmiques

La cyberlettre de juillet

Hello à toutes et à tous,

Avez-vous vu qu’aux Etats-Unis, IBM puis Amazon renonçaient à fournir leurs algorithmes de reconnaissance faciale à la police ? La décision a été prise début juin, dans le courant de l’affaire George Floyd. La plateforme de e-commerce a précisé : “Nous espérons que ce moratoire d’un an donnera suffisamment de temps au Congrès pour mettre en place les règles appropriées”. Microsoft n’a pas tardé à adopter la même posture que ses deux concurrents.

Si, en termes de “règles appopriées”, Amazon évoque un projet plus large - une loi portée par les Démocrates pour “transformer” la culture de la police américaine -, la question de l’usage d’outils de reconnaissance faciale par les forces de l’ordre est cruciale. Car ces technologies permettent d’indubitables bonds dans l’efficacité des procédures : pouvoir comparer la photo d’un suspect à la banque de 300 000 portraits pris à la prison régionale depuis 2001, c’est l’assurance d’aller beaucoup plus vite. Et c’est ce que permettait l’outil Rekognition d’Amazon, testé en en 2019 en Oregon. Sauf que si l’outil se trompe, le risque de mettre un·e innocent·e sous les verrous augmente aussi.

Or le MIT a mené une étude sur trois grands logiciels commerciaux recourant à la reconnaissance faciale, qu’il a publiée en 2018. Celle-ci démontrait que les femmes et les noir·es couraient plus de risques que les hommes et les blanc·hes d’être mal identifié·es. Les femmes à la peau la plus foncée pouvant cumuler jusqu’à obtenir un taux d’erreur de 34,7 %. Si l’algorithme risque une fois sur trois de vous confondre avec un·e criminel·le, le problème est criant. Que l’actualité pousse de grands éditeurs à demander des régulations, c’est plutôt un progrès puisque ça rend la problématique plus visible.

Cela dit, ça n’empêche pas que de nouveaux risques surgissent autre part. C’est l’exemple qu’a laissé voir l’outil Pulse, quelques semaine plus tard. Mis au point par des chercheurs de l’Université de Duke, il a fasciné les photographes pour sa capacité à reconstituer des portraits en très haute définition à partir d’images très pixelisées. C’est un progrès parce que jusqu’ici, les algorithmes avaient beaucoup de mal à reconstruire des images contenant des données manquantes. Alors que là, ça fonctionne plutôt bien :

Sauf que si l’on s’appelle Barack Obama, Alexandria Ocasio-Cortez, ou, bref, que l’on a la peau quelque part entre le mat et le noir, ça peut aussi donner ceci :

Bref, il reste du travail. Sur les réseaux, on propose d’ailleurs aux concepteurs de Pulse d’élargir la base de données qui a servi à l’entraîner, de modifier certaines de ses composantes (il est construit sur des algorithmes pré-existant de reconnaissance d’images), ou encore, comme souvent, de rendre plus diverses les équipes qui permettent de construire ce type de techno. Et puis, comme Pulse vient tout juste d’être publié, on peut espérer qu’il soit amélioré avant de trouver des usages commerciaux.

Ce que je note de positif, c’est que si IBM, Amazon et Microsoft s’en remettent aujourd’hui aux régulateurs, s’il est est aussi “naturel” de proposer des solutions à des concepteurs d’algorithmes via Twitter, c’est certainement que le sujet prend peu à peu l’importance qu’il mérite. Car, smartphones en main, nous utilisons déjà quantité d’outils technologiques potentiellement problématiques.

Si vous voulez en savoir un peu plus sur les personnes qui luttent, depuis plusieurs années déjà, pour corriger ces défauts, je vous suggère de lire ce long format publié par The Correspondent en mars dernier.

📨 Un avis, une question, une idée ? Un sujet que vous voudriez me voir expliquer ?

Pour me joindre, répondez à ce mail ou contactez-moi sur twitter.

En période de grands débats politiques, je me pose toujours un nombre accru de questions sur l’industrie dans laquelle je travaille. Je commencerai donc mes conseils de lectures avec des choses qui m’ont fait réfléchir sur les médias :

Regardez l’émission proposée par l’AJL (Association des Journalistes LGBTQI+) à la fin du mois des fiertés. Elle pose plein de questions judicieuses sur le traitement médiatique de quelques événements récents - les violences policières, la PMA, etc. (AJL)

Pour un exemple de traitement médiatique raté parce que les journalistes (principalement blanc·hes) ne connaissaient pas le sujet du colorisme, je vous recommande l’interview de la chercheuse Mame-Fatou Niang. Elle y évoque la manière dont les médias ont parlé de l’Oréal lorsque l’entreprise a enlevé les termes “blancs” ou “blanchissants” de certains produits de beauté voués à éclaircir la peau. Et revient sur le problème de santé publique que représente l’usage (très répandu) de ce type de produits, sources de maladies allant jusqu’au cancer de la peau. (Les Inrocks)

Je connais très peu le sujet évoqué, mais ce thread a l’avantage de mettre en évidence deux biais importants lors de la consommation d’information : le biais cognitif et le biais d’aisance. (Gabrielle Dufour)

Je regarde avec inquiétude les logiques de cyber-harcèlement se répandre partout. Ca n’a rien de neuf, mais ce mois-ci plusieurs exemples m’ont sauté aux yeux. Ici un exemple des fans de Dieudonnée envers la Licra, puis de la Licra envers ceux qui les insultent, là une journaliste du NYT harcelée par un gérant de fonds de capital-risque, lui même déclarant défendre une entrepreneure harcelée… Sans prendre parti, je crois que tout ce petit monde ignore beaucoup trop facilement l’impact que peuvent avoir de telles campagnes sur les personnes, derrière leurs écrans. Bref, je prie pour un jour où on sera tous·tes formé·es à ces problématiques (d’ailleurs j’ai préparé un cours dessus, avec Prenons la Une, au cas où ça vous intéresse).

💻 Côté tech :

Belle enquête de Judith Duportail et Nicolas Kayser-Bril qui démontre comment les algorithmes d’Instagram offrent une prime à la nudité. Problématique hypocrite, d’une part (il faut être quasi nu, mais pas totalement, sinon on risque la censure), et très pratique d’autre part : celles et ceux qui utilisent cette plateforme dans le cadre de leur métier en viennent à imaginer des mises en scène difficilement pensables dans tout autre cadre de travail. (Mediapart)

Le fondateur de Twitter Jack Dorsey a décrété qu’il donnerait un milliard de dollars à des associations participant à la lutte contre le coronavirus, partout dans le monde, de manière transparente. Il a publié un excel ouvert permettant à n’importe qui d’aller consulter les choix faits dans les donations. Et ça fonctionne plutôt bien (et visiblement plus vite que via d’autres canaux de donations). (Recode)

J’avais complètement loupé l’info mais Facebook va payer 52 millions de dollars aux personnes souffrant de stress post-traumatique à force d’avoir travaillé à la modération du réseau social. (The Verge)

📰 Des sujets moins numériques sur lesquels j’ai appris des choses :

En cinq ans, le nombre d’attentats d’extrême-droite a triplé en Occident. Cette enquête en trois épisodes jette un autre regard sur ces attaques généralement balayées dans l’actu, grâce à une description préférant utiliser les termes de “déséquilibré” que de '“terroriste”, pour qualifier l’auteur. (Slate)

Libé a publié une grosse enquête sur la culture de harcèlement qui règne au sein d’Ubisoft. Encore une démonstration que les entreprises qui se la jouent très cool, voire “great place to work” (un label RH) ne sont pas épargnées par ces problématiques dévastatrices. (Libération)

Visiblement, la société continue de réfléchir comme si, dans les familles, il y avait toujours un parent disponible h24 pour s’occuper des enfants. En réalité, les choses ont évolué, mais en période de confinement, celle·ux qui mènent de front travail et éducation ont beaucoup souffert. (New-York Times)

Sur le débat du déboulonnage de statues des “grands hommes” esclavagistes d’autrefois, je vous signale un intéressant thread historique sur le parc de monuments publics français. On y apprend que si les réserves statuaires françaises manquent autant de représentations des faits d’armes des Français·es d’outre-mer et des personnalités anti-esclavagistes, c’est notamment à cause de décisions prises sous le régime de Vichy. (Benoît Vaillot)

P.S.

Quatre conseils culture

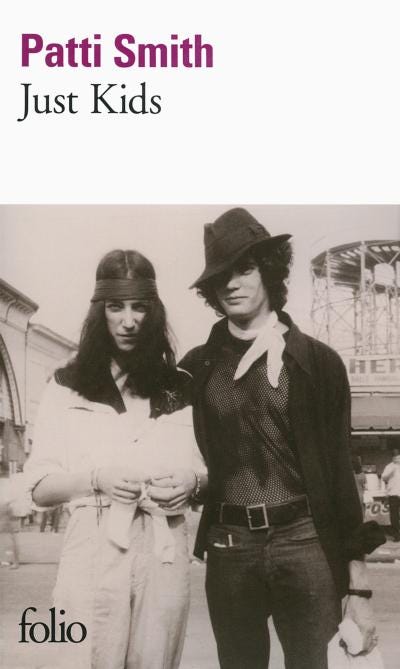

Un livre : Just Kids de Patti Smith. Un vrai plaisir de se plonger dans le New-York des années 60-70, de suivre la jeunesse et la genèse de l’artiste, d’écouter de vieux morceaux de The Dovells ou de Lotte Lenya parce qu’elle les mentionne, de voir passer Janis Joplin et Jimi Hendrix en arrière plan de sa propre histoire.

Une série : I May Destroy you. Gros succès du moment, bien mérité tellement cette série est parfaitement écrite, jouée, réalisée. Soyons clairs, ça parle de viol, mais plus que sur le crime en lui-même, la série s’attarde sur ses effets sur la millennial flamboyante qu’est Arabella. Et puis elle soulève habilement d’autres problématiques, aussi diverses que la précarité, le manque de diversité dans le milieu de l’édition, les faux-semblants du monde des start-ups, etc.

Un podcast : Bookmakers, sur Arte radio, revient chaque mois sur le travail d’un·e écrivain·e. Philippe Jaenada, Alice Zeniter, Delphine de Vigan… Chacun·e raconte la genèse d’un roman en particulier, ses tics et ses astuces d’écriture, sa relation au monde de l’édition, au public. C’est précis et bien écrit, une super manière de (re)découvrir La petite femelle, L’art de perdre ou Rien ne s’oppose à la nuit.

Une sortie : si vous êtes à Paris ce mois-ci, allez faire un tour à la Villette. Le lieu est investi d’artistes à qui espaces ont été donnés pour créer leurs oeuvre - et pour que le public les voient faire, dans le respect des limitations posées par le COVID-19. Si vous voulez voir un spectacle de cirque ou de marionettes se construire, c’est l’endroit parfait. Si vous avez le temps, passez aussi écouter Thierry Collet. Il teste un spectacle de magie dans lequel il joue avec des outils numériques, et c’est très bien écrit.

Vous avez aimé cette édition ?

Si oui, partagez la autour de vous !

À très vite,

— Mathilde