[S01E01] La première lettre

Où je vous dis "bonjour, ravie de vous avoir au bout du mail !" et je vous parle doppelgänger.

Lectrices et lecteurs de la première heure,

Un peu plus d’un an après mon départ d’un premier projet de newsletter, voici que la plume me démange à nouveau. Je croise trop de sujets intéressants au cours de ma veille quotidienne pour ne pas les partager et les discuter avec vous.

Comme vous êtes mes premier·e·s destinataires, soyez sûr·e·s que vous occupez une place spéciale dans mon coeur. N’hésitez pas à me faire vos retours, vos commentaires, me dire ce qui vous plaît et surtout ce qui ne vous plaît pas, dans le fond comme la forme de la cyberlettre. N’hésitez pas non plus à me demander de me pencher sur des sujets particuliers.

Cela me permettra de vous proposer une lecture qui n’en sera que meilleure.

📨 Et si vous souhaitez me joindre, répondez à ce mail ou contactez-moi sur twitter.

La semaine dernière, dans un de mes moments d’errements sur Twitter, je suis tombée sur cette vidéo de Marine Le Pen parlant arabe, vêtue d’un hijab.

Si vous n'arrivez pas à lire la vidéo, cliquez sur la date, en-dessous. Elle s'ouvrira dans votre navigateur.Fabuleux n’est-ce pas ?

Et bien c’est un faux. Un deep fake, précisément. Rendu possible par ces algorithmes qui investissent depuis quelques temps le monde merveilleux des imitations plus vraies que nature, en photo d’abord, puis en vidéo et maintenant en audio. Ils progressent à un rythme fantastique, ou affolant, ou les deux.

Car avant Marine Le Pen, il y a eu, fin juillet, Mark Zuckerberg tenant un discours terrible de cynisme. La première phrase était : « Imaginez une seconde : un homme, avec un contrôle total de milliards de données volées aux gens, tous leurs secrets, leurs vies, leur futur… ». Encore un faux. Quelques semaines plus tôt, c’est l’application DeepNude qui défrayait la chronique. Elle permettait de choisir l’image d’une femme habillée, puis, grâce à son algorithme, de la déshabiller entièrement, ou en tout cas de faire comme si. Heureusement pour mon petit coeur malmené de féministe, l’application a fini par être dépubliée.

Mais le meilleur, dans cette histoire de deep fake, c’est encore lorsque que quelques habiles criminels ont la brillante idée de mêler cette technologie à un type bien précis d’arnaque. La fraude au patron, dont j’ai découvert le concept pour l’occasion, est une méthode qui consiste à se faire passer pour le big boss afin de demander à un·e employé·e de fournir des documents sensibles ou, le plus souvent, de faire des virements aux montants mirobolants.

Fin août, le Wall Street Journal révélait donc qu’un cadre d’une entreprise britannique spécialisée dans l’énergie s’était fait avoir. Reproduisant la voix de son patron, les fraudeurs ont demandé - et obtenu - un transfert de 220 000 euros. Le nom de la société victime reste inconnu, mais son assureur, Euler Hermes, a donné quelques détails sur l’opération.

On sait ainsi qu’une fin d’après-midi, le cadre en question a reçu un appel de son supérieur. Celui-ci lui demandait de transférer de l’argent vers un compte en Hongrie, “pour payer des amendes en retard”. L’homme s’est exécuté, sans déceler qu’il s’agissait d’une voix de synthèse : celle-ci était suffisamment réussie pour imiter la tonalité, la ponctuation… jusqu’à l’accent allemand du dirigeant !

Les soupçons sont apparus lorsque le cadre, voulant vérifier quelques informations auprès de son n+1, s’est retrouvé à devoir gérer un appel avec son vrai boss, et un autre avec… et bien, visiblement, un faux patron.

Affaire rocambolesque. Sachez que, malgré tout, les experts en cybersécurité estiment que cette méthode d’attaque reste relativement neuve et rare.

Néanmoins.

Nous créons actuellement les outils qui nous empêche(ro)nt de croire nos propres sens. Et la simple idée que nous en soyons à ce stade me paraît totalement vertigineuse. Car exposé·e·s à tous ces objets trafiqués mais extrêmement réalistes, comment reconnaître le vrai du faux ?

N.B. : Quelques heures après que j’ai terminé d’écrire ce premier post, Google a annoncé s’apprêter à publier près de 3000 deep fakes pour aider la recherche à créer des outils de détection de ces faux. Reste à voir quelles techniques seront imaginées.

📰 P.S.

En ce moment, sur internet, je lis

Comment les Furby, ces immondes peluches typiques de nos années 90, nous auraient aidés à accepter l’intelligence artificielle. Peut-être pour vous, mais certainement pas pour moi : j’ai la phobie de ces peluches aux yeux mobiles depuis que j’ai lu Lunar Park de Bret Easton Ellis (spoiler : on y croise un Furby tueur).

Une oeuvre inconnue de Picasso vient d’être reconstituée par un réseau de neurones. Comment ça reconstituée ? Le peintre avait repris la toile déjà utilisée pour y peindre Le vieux guitariste. Les chercheurs Anthony Bourached et George Cann du University College de Londres ont utilisé la technique du transfert de style par IA (neural style transfer) pour révéler La femme perdue, cachée en dessous depuis plus d’un siècle.

Après les révolutions arabes, les 99%, Nuit Debout, les Gilets Jaunes ou la révolution des parapluies, à Hong Kong, les manifestants mènent aussi une bataille numérique. Cet entrelacement désormais constant entre mouvements sociaux en ligne et hors ligne est un puit sans fonds de réflexions, mais aussi de créativité. On y reviendra certainement dans une prochaine édition.

Un entretien avec la passionnantes Gisèle Halimi, avocate “parce que l’injustice lui est “physiquement intolérable””, et féministe parce que, dès sa jeunesse, elle n’a pas compris pourquoi “être une fille impliquait un sort différent de celui de [ses] frères”. Elle a cette phrase terrible : “j’étais l’inessentielle” (car toute l’attention était portée sur ses frères aînés). Jolie leçon, de vie et d’Histoire.

D’ailleurs, Gisèle Halimi a défendu Marie-Claire Chevalier lors du procès de Bobigny, en 1972, poussant la question de l’avortement à l’agenda politique. Mais où en est ce droit 44 ans après sa légalisation ? Alexandre Léchenet et Rozenn Le Saint ont fait un très bon long format sur l’accès inégal à l’avortement en France. C’a du leur prendre des plombes, mais le résultat est probant : des cartographies précises, la démonstration que ce droit reste malmené en 2019, et, pour chaque obstacle pointé, des suggestions de pistes pour progresser.

Je pensais m’arrêter à cinq liens, mais entre temps Chirac, Président de mon enfance, est décédé. Je vous offre donc ce petit retour vers le passé, sujet télévisé du jour où l’Élysée a ouvert un site internet depuis lequel il était possible d’écrire au Président (je me suis réjouie d’apprendre que la réponse, elle, était envoyée par courrier).

Une image

It’s not a deep fake, it’s a double exposition

Et pour finir

Un conseil culture

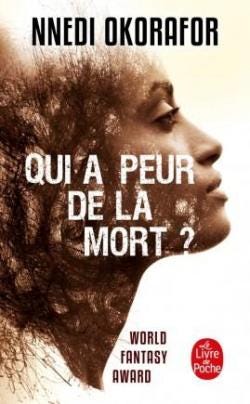

Qui a peur de la mort, de Nnedi Okorafor. Un roman classé science-fiction, mais qu’on pourrait mettre en fantasy : on y trouve moins de science que de magie. Mais une magie particulière : les pouvoirs et le mysticisme des chamans des terres centrafricaines. On y trouve des ordinateurs, aussi, mais absolument pas considérés de la même manière que dans un roman (ou une pensée) occidental(e).

Et de toute façon, ce ne sont pas eux le sujet. Le vrai, le coeur du roman, c’est son héroïne Onyesonwu, splendide personnage de jeune femme en plein apprentissage, évoluant dans la cruauté d’une Afrique post-apocalyptique. Rejetée car elle est le fruit d’un viol, elle comprend peu à peu que sa destinée est toute autre que de rester à la marge de la société.

Je ne vous cache pas que certains passages, au début notamment, sont durs à lire. Une ou deux descriptions crues de violence brute, en particulier. Mais ça ne m’a pas empêché de lire Qui a peur de la mort d’une traite. C’est brillant.

Vous avez aimé cette lettre ? Faites-le savoir sur les réseaux ou transférez-là à vos proches !

À très vite,

— Mathilde